Meta Learning - Learning to learn 배우는 방법을 배운다

meta라는 단어는 한 차원 위의 개념적 용어로 대상의 전반적인 특성을 반영한다.

그래서 메타 러닝은 데이터의 패턴을 정해진 프로세스로 학습하는 것이 아니라,

데이터의 특성에 맞춰 모델 네트워킄 구조를 변화 시키면서 학습 한다.

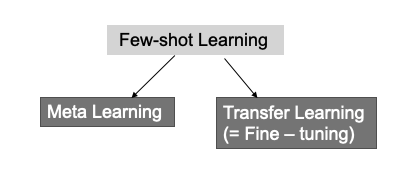

Few shot learning

- 모델이 추론하는 과정에서 소량의 데이터만 보고 추론을 하는 경우를 few-shot 라고 한다.

- 용어 정리 :

- way: 데이터 클래스의 개수

- shot, point: 데이터의 개수

- query: test data (validation data)

- source: train data

- Few shot Learning 의 목적은 말 그대로 적은 데이터로 추론이 가능하게 하는 것

메타러닝이란?

메타러닝은 적은 데이터로 모델을 훈련하면서 관련 task를 모두 수행 할 수 있다. Task A만 훈려시키면 task B는 추가적인 훈련 없이도 바로 구분해 낼 수 있느 모델이 탄생하는 것이다

메타 러닝 및 퓨샷 러닝의 대표적 접근 방법은 거리 학습 기반(Metric Based Learning)과 모델 기반 학습 방식(Model-Based Approach)과 최적화 학습 방식(Optimizer Learning)이 있습니다.

거리 학습 기반은 '효율적 거리 측정' 학습이 핵심입니다.

모델 기반 학습은 '메모리를 이용한 순환 신경망'이 핵심입니다.

최적화 학습 방식은 '모델 파라미터 최적화'이 핵심입니다.

조금 더 자세하게 알아보도록 하겠습니다.

거리 학습 기반 (Metric Based Learning)

딥러닝을 공부하고 계신 분들이라면 클래스 별 학습 데이터가 적은 경우 과적합이 일어나기 쉽다는 것을 알고 계실텐데요.

메타 러닝의 방법론 중 하나인 거리 학습 기반은 서포트 셋과 쿼리 셋 간의 거리(유사도)를 측정하는 방식으로 대신합니다.

거리 학습 기반을 활용한 대표적 알고리즘에는 샴 네트워크(Siamese Neural Network)가 있습니다.

모델은 주어진 서포트 데이터를 특성 공간(Feature Space)에 나타내서 특징을 뽑아냅니다.

같은 클래스면 거리를 가깝게 다른 클래스면 멀게 하는 방식으로 데이터를 분류합니다.

쿼리 데이터를 유클리디안 거리가 가까운 서포트 데이터의 클래스로 예측하는 방식입니다.

쿼리 데이터 클래스 예측 과정 도식화

모델 기반 학습 방식 (Model based learning)

모델 기반 학습 방식은 적은 수의 학습 단계로도 모델의 파라미터를 효율적으로 학습할 수 있는 방식입니다.

모델에 별도의 메모리를 두어 학습 속도를 조절합니다.

모델 기반 학습 방식의 대표적인 알고리즘인 MANN(Memory-Augmented Neural Networks)은 외부 메모리를 보유하고 있습니다.

과거 데이터를 외부 메모리에 저장함으로써 효율적으로 문제를 해결하는 방법을 습득합니다.

새로운 정보를 빠르게 인코딩하고 몇 개의 샘플만 가지고도 새로운 태스크에 적용할 수 있도록 설계되었기 때문에 메타 러닝의 대표적인 접근론 중 하나 입니다.

MANN 아키텍쳐

최적화 학습 방식(Optimizer learning)

퓨삿 태스크를 파라미터 최적화 문제로 생각 합니다.

일반적으로 딥러닝 모델은 기울기의 역전파를 통해 학습을 진행합니다.

하지만 기울기 기반 최적화 기법은 퓨샷 태스크가 아닌 큰 스케일의 데이터를 위해 설계가 되었죠?

최적화 기반 메타 러닝은 적은 수의 샘플에 대한 최적화 기법에 대해 다룹니다.

대표적으로 MAML(Model-Agnostic Meta-Learning) 알고리즘이 있습니다.

아래의 그림을 보면 실선은 각 태스크에서 계산했던 그래디언트를 합산하여 모델을 업데이트하는 것을 의미합니다.

즉 1, 2, 3의 데이터에서 학습된 그래디언트 정보로 전반적인 파라미터를 업데이트 합니다.

공통 파라미터로부터 다시 모델이 각 데이터를 학습하면서 세부 파라미터를 업데이트(점선)합니다.

이런 과정을 최적의 파라미터를 찾을 때까지 반복하면 모델의 파라미터를 최적화할 수 있습니다.

다음에 정리할 내용

1 ) meta learning + RL

2) meta learning + RL 에서 가장 유명한 논문 : Diversity is all you need: Learning skills without a reward function

MAML

https://ratsgo.github.io/nlpbook/docs/introduction/transfer/

Transfer Learning

pratical tips for Natural Language Processing

ratsgo.github.io

참고 : https://velog.io/@tobigs16gm/Few-Shot-Learning

Few-Shot Learning

Few-Shot Learning

velog.io

참고 : https://huidea.tistory.com/252?category=879542

[Deep Learning] Few shot Learning, Meta learning 개념 총정리

Few shot Learning, Meta learning 개념 총정리 Index 0. Few-shot learning 의 등장 배경 : " 학습 데이터가 없다 " 1. Few shot learning, Meta learning, Transfer learning 뭐가 다른데? 2. Episode training : 에피소드 방식을 통해 메

huidea.tistory.com

https://bigwaveai.tistory.com/18

메타 러닝(Few Shot Task) - 적은 데이터로도 성능은 강력하게!

안녕하세요! 빅웨이브에이아이의 박정환입니다. 지난 포스팅 글은 딥러닝에 대해서 쉽고 간단하게 알아보았었는데요 ! 이번 포스팅의 주제는 딥러닝 세계에서 떠오르는 학습 방법인 '메타 러닝

bigwaveai.tistory.com

'Machine Learning' 카테고리의 다른 글

| what is Grid search? (0) | 2023.07.19 |

|---|---|

| [summary]what is BERT? (0) | 2023.07.05 |

| [내용정리]Meta Learning (1) | 2022.11.25 |

| [Deep Learning Architecture] CNN, RNN, Attention-based (0) | 2022.11.24 |

| [논문리뷰]Time Series Forecasting With Deep Learning A Survey (0) | 2022.11.24 |